Številna podjetja, vključno z Microsoft і Facebook, in celo raziskovalci z Univerze Južne Kalifornije razvijajo tehnologije za boj proti globokim ponaredkom in preprečevanje njihovega širjenja z rumenimi mediji in dezinformacijami na splošno. Vendar jih je skupini znanstvenikov vseeno uspelo pretentati.

Skupina računalniških znanstvenikov na kalifornijski univerzi v San Diegu je opozorila, da je še vedno mogoče preslepiti obstoječe sisteme za odkrivanje globokih ponaredkov z vstavljanjem vhodnih podatkov, imenovanih "konkurenčni primeri", v vsak video okvir. Znanstveniki so svoje ugotovitve predstavili na konferenci o računalniškem vidu WACV 2021, ki je prejšnji mesec potekala na spletu.

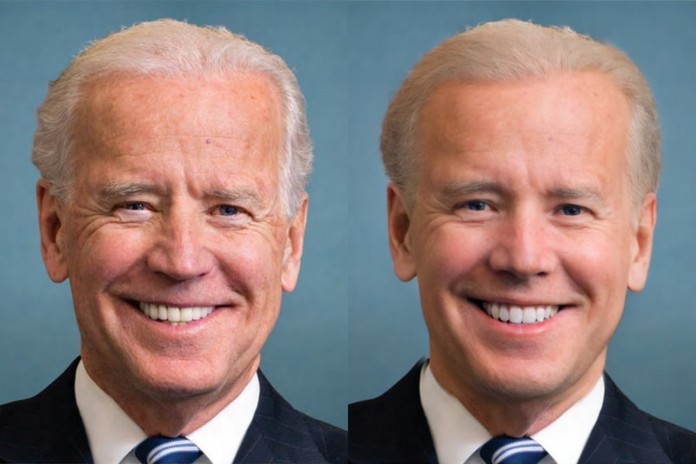

Konkurenčni primeri so rahlo spremenjeni vhodi, zaradi katerih sistemi umetne inteligence, kot so modeli strojnega učenja, delajo napake. Poleg tega je ekipa pokazala, da napad še vedno deluje po stiskanju videa. V zgornjem videoposnetku znanstveniki pokažejo, da XceptionNet, detektor globokih ponaredkov, njihov konkurenčni video označi kot "resničnega".

Večina teh detektorjev deluje tako, da sledi obrazom v videu in pošilja podatke o obrezanem obrazu nevronski mreži v analizo. Nevronska mreža bo nato analizirala te podatke in našla elemente, ki so običajno slabo reproducirani v globokih ponaredkih, kot je utripanje.

Z vstavljanjem konkurenčnih primerov so raziskovalci ugotovili, da lahko te detektorje globokih ponaredkov preslepijo, da verjamejo, da so videoposnetki resnični.

V prispevku navajajo, da je »za uporabo teh detektorjev globokih ponaredkov v praksi pomembno, da jih ocenimo glede na prilagodljivega nasprotnika, ki se zaveda te zaščite in jo namerno poskuša zlomiti. Pokazali smo, da je mogoče sodobne metode odkrivanja globokih ponaredkov zlahka obiti, če se napadalec v celoti ali celo delno zaveda detektorja."

Kot so pokazali ti znanstveniki, tehnologije avtomatizacije, ki se razvijajo za boj proti dezinformacijam, morda še niso kos nalogi.

Preberite tudi: